Kubernetes介绍

官网:https://kubernetes.io/

一、应用部署方式演变

1、传统部署:互联网早期,会直接将应用程序部署在物理机上

优点:简单,不需要其他技术的参与

缺点:不能为应用程序定义资源使用边界,很难合理地分配计算资源,而且程序之间容器产生影响

2、虚拟化部署:可以在一台物理机上运行多个虚拟机,每个虚拟机都是独立的一个环境

优点:程序环境不会相互产生影响,提供了一定程度的安全性

缺点: 增加了操作系统,浪费了部分资源

3、容器化部署:与虚拟化类似,但是共享了操作系统

优点:可以保证每个容器拥有自己的文件系统、CPU、内存、进程空间等。

运行应用程序所需要的资源都被容器包装,并和底层基础架构解耦。

容器化的应用程序可以跨云服务商、跨Linux操作系统发行版进行部署。

容器化部署方式给带来很多便利,但是也会出现一些问题,比如说:

(1)一个容器故障停机了,怎么样让另外一个容器立刻启动去替补停机的容器

(2)当并发访问量变大的时候,怎么样做到横向扩展容器数量

这些容器管理的问题统称为容器编排问题,为了解决这些容器编排问题,就产生了一些容器编排的软件:

Swarm:docker自己的容器编排工具

Mesos:apache的一个资源统一管控的工具,需要和marathon结合使用

Kubernetes:google开源的容器编排工具

二、kubernetes简介

Kubernetes,是一个全新的基于容器技术的分布式架构领先方案,是谷歌严格保密十几年的秘密武器—Borg系统的一个开源版本,于2014年9月发布第一个版本,2015年7月发布第二个正式版本。

Kubernetes的本质是一组服务器集群,它可以在集群的每个节点上运行特定的程序,来对节点中的容器进行管理。目的是实现资源管理的自动化,主要提供了如下的主要功能:

1、自我修复:一旦某个容器崩溃,能够在1秒中左右迅速启动新的容器

2、弹性伸缩:可以根据需要,自动对集群中正在运行的容器数量进行调整。

3、服务发现:服务可以通过自动发现的形式找到它所依赖的服务

4、负载均衡:如果一个服务启动了多个容器,能够自动实现请求的负载均衡

5、版本回退:如果发现新发布的程序版本问题,可以立即回退到原来的版本

6、存储编排:可以根据容器自身的需求自动创建存储卷

三、kubernetes组件

一个kubernetes集群主要是由控制节点(master)、工作节点(node)构成,每个节点上都会安装不同的组件。

Master:集群的控制平面,负责集群的决策(管理)

Apiserver:资源操作的唯一入口,接收用户输入的命令,提供认证、授权、API注册和发现等机制。

Scheduler:负责集群资源调度,按照预定的调度策略将pod调度到相应的node节点上。

ControllerManager:负责维护集群的状态,比如程序部署安排、故障检测、自动扩展、滚动更新等。

Etcd:负责存储集群中各种资源对象的信息。

Node:集群的数据平面,负责为容器提供运行环境(干活)

Kubelet:负责维护容器的生命周期,即通过控制docker来创建、更新、销毁容器

Docker:负责节点上容器的各种操作

下面以部署一个nginx服务来说明kubernetes系统各个组件的调用关系:

1、首先要明确,一旦kubernetes环境启动之后,master和node都会想自身的信息存储导etcd数据库中

2、一个nginx服务的安装请求会首先被发送到master节点的apiserver组件

3、Apiserver组件会调用scheduler组件来决定到底应该把这个服务安装导哪个node节点上

4、Apiserver调用controller-manager去调度node节点安装nginx服务

5、Kubelet接收到指令后,会通知docker,然后由docker来启动一个nginx的pod,pod是kubernetes的最小操作单元,容器必须跑在pod中

一个nginx服务就运行了,如果需要访问nginx,就需要通过kube-proxy来对pod产生访问的代理,这样外界用户就可以访问集群中的nginx服务了。

四、kubernetes概念

Master:集群控制节点,每个集群需要至少一个master节点负责集群的管控

Node:工作负载节点,由master分配容器到这些node工作节点上,然后node节点上的docker负责容器的运行

Pod:kubernetes的最小控制单元,容器都是运行在pod中的,一个pod中可以有1个或者多个容器

Controller:控制器,通过它来实现对pod的管理,比如启动pod、停止pod、伸缩pod的数量等等

Service:pod对外服务的统一入口,下面可以维护者同一类的多个pod

Label:标签,用于对pod进行分类,同一类pod会拥有相同的标签

Namespace:命名空间,用来隔离pod的运行环境

K8s集群环境搭建

一、环境规划

1、集群类型

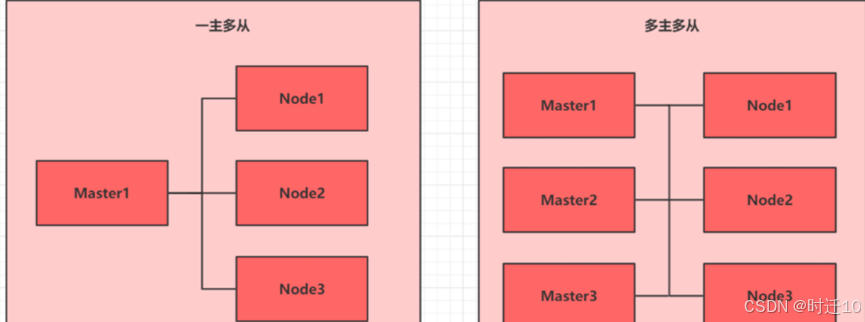

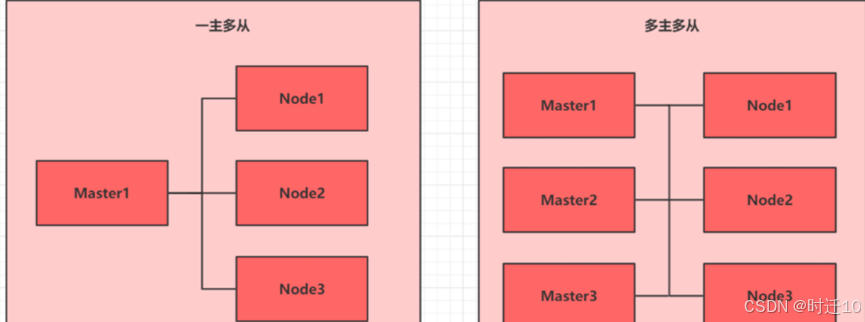

Kubernetes集群大体上分为两类:一主多从和多主多从

一主多从:一台master节点和多台node节点,搭建简单,但是有单机故障风险,适用于测试环境

多主多从:多台master节点和多台node节点,搭建麻烦,安全性高,适用于生产环境

2、安装方式

Kubernetes有多种部署方式,目前主流的方式有kubeadm、minikube、二进制包

1、Minikube:一个用于快速搭建单节点kubernetes的工具

2、Kubeadm:一个用于快速搭建kubernetes集群的工具,https://kubernetes.io/docs/reference/setup-tools/kubeadm/kubeadm/

3、二进制包:从官网下载每个组件的二进制包,依次去安装,此方式对于理解kubernetes组件更加有效,https://github.com/kubernetes/kubernetes

说明:现在需要安装kubernetes的集群环境,但是又不想过于麻烦,所有选择使用kubeadm方式

3、主机规划

1

2

3

4

| 角色 ip地址 组件

master:192.168.100.111 docker,kubectl,kubeadm,kubelet

node1: 192.168.100.112 docker,kubectl,kubeadm,kubelet

node2: 192.168.100.114 docker,kubectl,kubeadm,kubelet

|

二、环境搭建

本次环境搭建需要安装三台Linux系统(一主二从),内置centos8系统,然后在每台linux中分别安装docker。kubeadm(1.25.4),kubelet(1.25.4),kubectl(1.25.4).

1、主机安装

安装虚拟机过程中注意下面选项的设置:

1、操作系统环境:cpu2个 内存2G 硬盘50G Rocky Linux9

2、语言:中文简体/英文

3、软件选择:基础设施服务器

4、分区选择:自动分区/手动分区

5、网络配置:按照下面配置网络地址信息

网络地址:192.168.100.(111、112、114)

子网掩码:255.255.255.0

默认网关:192.168.100.254

DNS:8.8.8.8

6、主机名设置:

Master节点:master

Node节点:node1

Node节点:node2

1.1禁用firewalld、selinux、postfix(三个节点都做)

1

2

3

4

5

6

7

8

9

10

11

12

| systemctl stop firewalld

systemctl disable firewalld

vim /etc/selinux/config

SELINUX=disabled

setenforce 0

systemctl stop postfix

systemctl disable postfix

|

2、主机名解析 (三个节点都做)

1

2

3

4

5

6

7

8

9

10

11

| [root@master ~]

//在该文件最后写入主机ip及主机名

127.0.0.1 localhost localhost.localdomain localhost4 localhost4.localdomain4

::1 localhost localhost.localdomain localhost6 localhost6.localdomain6

192.168.100.111 master

192.168.100.112 node1

192.168.100.114 node2

//直接传输到两台从节点

[root@master ~]

[root@master ~]

|

3、下载工具包,时间同步(三个节点都做)

1

2

3

4

5

6

| //三台主机都是一样的操作

[root@master ~]

[root@master ~]

[root@master ~]

[root@master ~]

|

4、禁用swap分区(三个节点都做)

1

2

3

4

5

| [root@master ~]

//注释掉swap分区那一行

[root@master ~]

[root@master ~]

|

5、开启IP转发,和修改内核信息—(三个节点都做)

1

2

3

4

5

6

7

8

| [root@master ~]

net.ipv4.ip_forward = 1

net.bridge.bridge-nf-call-ip6tables = 1

net.bridge.bridge-nf-call-iptables = 1

[root@master ~]

[root@master ~]

|

6、配置IPVS功能(三个节点都做)

1

2

3

4

5

6

7

8

9

10

11

12

13

14

| Rockylinux9中

/etc/modules-load.d/ipvs.modules这个文件

[root@master ~]

modprobe -- ip_vs

modprobe -- ip_vs_rr

modprobe -- ip_vs_wrr

modprobe -- ip_vs_sh

[root@master ~]

[root@master ~]

[root@master ~]

[root@master ~]

|

6.1、ipvs功能开机自启(三个节点都做)

1

2

3

4

5

6

7

8

9

10

11

12

13

14

| [root@master ~]

[Unit]

Description=Run a Custom Script at Startup

After=default.target

[Service]

ExecStart=/etc/modules-load.d/ipvs.modules

[Install]

WantedBy=default.target

[root@master ~]

[root@master ~]

|

注:这里做完最好留个快照

7、切换docker镜像源(三个节点都做)

1

2

3

4

5

6

7

| //这里使用的是阿里源

yum install -y yum-utils device-mapper-persistent-data lvm2

yum-config-manager --add-repo https://mirrors.aliyun.com/docker-ce/linux/centos/docker-ce.repo

sed -i 's+download.docker.com+mirrors.aliyun.com/docker-ce+' /etc/yum.repos.d/docker-ce.repo

|

8、安装docker-ce(三个节点都做)

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

| [root@master ~]

[root@master ~]

{

"registry-mirrors": [ "https://dockerpull.com",

"https://docker.anyhub.us.kg",

"https://dockerhub.jobcher.com",

"https://dockerhub.icu",

"https://docker.awsl9527.cn"],

"exec-opts": ["native.cgroupdriver=systemd"],

"log-driver": "json-file",

"log-opts": {

"max-size": "100m"

},

"storage-driver": "overlay2"

}

[root@master ~]

[root@master ~]

[root@master ~]

//最后在master节点测试能否pullnginx镜像

[root@master ~]

[root@master ~]

REPOSITORY TAG IMAGE ID CREATED SIZE

nginx latest 39286ab8a5e1 5 weeks ago 188MB

|

9、下载并解压cri-docker(三个节点都做)

10、下载并编辑cri-docker service文件

1

2

3

4

5

6

7

8

| [root@master01 ~]

[root@master01 ~]

//查看是否下载成功

[root@master ~]

-rw-r--r-- 1 root root 1319 Sep 21 10:44 cri-docker.service

-rw-r--r-- 1 root root 204 Sep 21 10:45 cri-docker.socket

|

修改cri-docker.service文件

1

2

3

| [root@master ~]

//修改ExecStart行内容为

ExecStart=/usr/local/bin/cri-dockerd --pod-infra-container-image=registry.aliyuncs.com/google_containers/pause:3.9 --container-runtime-endpoint=unix:///var/run/cri-dockerd.sock --cri-dockerd-root-directory=/var/lib/dockershim --cri-dockerd-root-directory=/var/lib/docker

|

修改cri-docker.socket文件

1

2

3

| [root@master ~]

//修改ListenStream行内容为

ListenStream=/var/run/cri-dockerd.sock

|

11、将修改后的文件分别传到node1、node2节点

1

2

3

4

|

[root@master ~]

[root@master ~]

|

12、启动cri-docker并设置自启动(三个节点都做)

1

2

3

| [root@master ~]

[root@master ~]

[root@master ~]

|

三、部署kubernetes集群

1、配置阿里云k8s源(三个节点都做)

1

2

3

4

5

6

7

| [root@master ~]

[kubernetes]

name=Kubernetes

baseurl=https://mirrors.aliyun.com/kubernetes-new/core/stable/v1.28/rpm/

enabled=1

gpgcheck=1

gpgkey=https://mirrors.aliyun.com/kubernetes-new/core/stable/v1.28/rpm/repodata/repomd.xml.key

|

2、安装集群所需软件包kubelet kubeadm kubectl(三个节点都做)

3、配置k8s Cgoup控制组(三个节点都做)

1

2

| [root@master ~]

KUBELET_EXTRA_ARGS="--cgroup-driver=systemd"

|

4、配置kubelet自启动,并初始化集群(三个节点都做)

1

2

3

| [root@master ~]

[root@master ~]

|

5、master节点打印文件

1

2

3

4

5

| //master节点所需的镜像文件

[root@master ~]

//打印集群初始化配置文件

[root@master ~]

|

6、master节点修改kubeadm参数

1

2

3

4

5

6

7

8

9

10

11

12

13

14

| [root@master ~]

…

localAPIEndpoint:

advertiseAddress: 192.168.100.111

bindPort: 6443

nodeRegistration:

criSocket: unix:///var/run/cri-dockerd.sock

imagePullPolicy: IfNotPresent

name: master

taints: null

…

…

…

imageRepository: registry.cn-hangzhou.aliyuncs.com/google_containers

|

7、使用配置文件初始化并配置环境变量

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

| [root@master ~]

//配置环境变量

[root@master ~]

export KUBECONFIG=/etc/kubernetes/admin.conf

[root@master ~]

[root@master ~]

[root@master ~]

[root@master ~]

[root@master ~]

//最后node1与node2节点都source一下

[root@node1 ~]

[root@node2 ~]

|

8、工作节点加入集群(node1节点、node2节点执行)

1

2

3

4

5

6

7

8

9

| [root@node1 ~]

//master节点查看

[root@master ~]

NAME STATUS ROLES AGE VERSION

master NotReady control-plane 41m v1.28.14

node1 NotReady <none> 65s v1.28.14

node2 NotReady <none> 8s v1.28.14

|

9、下载calico文件

10、创建calico网络(master节点)

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

| //查看容器的创建信息,状态都为Running才可以

[root@master ~]

NAME READY STATUS RESTARTS AGE

calico-kube-controllers-9d57d8f49-v96ft 1/1 Running 0 2m41s

calico-node-cl9xq 1/1 Running 0 2m41s

calico-node-d2hvj 1/1 Running 0 2m41s

calico-node-r9kcm 1/1 Running 0 2m41s

coredns-6554b8b87f-44pf6 0/1 Running 0 60m

coredns-6554b8b87f-kmtcx 1/1 Running 0 60m

etcd-master 1/1 Running 1 (46m ago) 60m

kube-apiserver-master 1/1 Running 1 (46m ago) 60m

kube-controller-manager-master 1/1 Running 1 (46m ago) 60m

kube-proxy-g96gn 1/1 Running 0 20m

kube-proxy-zl9cd 1/1 Running 0 19m

kube-proxy-zrqwk 1/1 Running 1 (46m ago) 60m

kube-scheduler-master 1/1 Running 1 (46m ago) 60m

//查看网络状态

[root@master ~]

NAME STATUS ROLES AGE VERSION

master Ready control-plane 61m v1.28.14

node1 Ready <none> 21m v1.28.14

node2 Ready <none> 20m v1.28.14

|

11、使用k8s集群创建一个pod,运行nginx容器,然后进行测试

master节点操作

1

2

3

4

5

6

7

8

| [root@master ~]

deployment.apps/nginx created

[root@master ~]

service/nginx exposed

[root@master ~]

NAME READY STATUS RESTARTS AGE IP NODE NOMINATED NODE READINESS GATES

nginx-7854ff8877-jgk4b 0/1 ContainerCreating 0 53s <none> node1 <none> <none>

|